相互竞争的汽车传感器数据融合方法

作者:

日期:2021-11-06

相互竞争的汽车传感器数据融合方法

随着今天的内燃机被电动/电子汽车所取代,机械系统传感器将被众多电子传感器所取代,以实现高效运行和实现不同程度的自主性。这些新传感器中的一些将单独运行,但许多突出的传感器将需要将其输出与其他传感器的输出结合或“融合”,以最大限度地发挥其价值。

目前尚不清楚的是,传感器数据融合将在汽车内发生的位置,或者数据将如何组合、排序和先后处理。

Flex Logix 的 IP 销售和营销副总裁 Andy Jaros 表示:“很明显,当今汽车中传感器数据过多,处理能力不足,传感器融合将会发生。” “这将如何发生仍在发展中,并将取决于汽车系统设计师对每种车型的决定。”

来自摄像头、雷达和激光雷达等传感器的数据流可以通过多种方式进行组合,以提供新的或更可靠的信息。处理发生的位置有助于为网络架构提供信息,但它也会影响人工智能 (AI) 对数据的操作方式。

“预计原始数据将与相机或其他传感器融合,然后进入感知引擎,以产生更好的结果,”赛灵思汽车高级总监 Willard Tu 说。

而关于这一切将如何运作没有普遍的共识,但有很多意见。 Synopsys 高级产品营销经理约翰斯旺森说:“老实说,我认为现在有点像宗教信仰。”

传感器融合的基础

自从大约 10 年前大型电子传感器推出以来,传感器融合一直很流行。这个想法是通过结合几个不完美传感器的结果,可以获得更好的整体测量。一种看待它的方式是一个传感器可以覆盖另一个传感器的弱点。例如,来自加速度计、陀螺仪和磁力计的数据如今结合在一起,可以提供更好的位置和导航信息。

Rambus 安全技术产品经理 Thierry Kouthon 说:“[汽车中] 传感器融合的目的是让汽车能像人类一样感知汽车,因为人类具有视觉、听觉和嗅觉。” . “而汽车没有那个,所以我们必须用具有相同精度的东西来代替它。”

在电动/电子 (E/E) 车辆中,大部分焦点都集中在与视觉相关的传感器上:摄像头、雷达和激光雷达。它们远不是车辆中唯一的传感器,但与性能相关的传感器——显示事情进展的监视器——更有可能独立运行。

这些监视器本身很可能会进入电子设备,尽管它们与内燃机 (ICE) 所需的监视器完全不同。 “在内燃机中,您至少有 15 个外部监视器来监控发动机本身,”proteanTecs 汽车部总经理 Gal Carmel 指出。 “但是在电动汽车中,你不再有发动机了。你有一个电池,你有一个电池管理系统。所以你看到的趋势基本上是将所有这些显示器放在电子设备中。”

视觉传感器要复杂得多,它们必须处理的情况——变化的光线、天气、各种感兴趣的物体——意味着每个传感器都有其优点和缺点。这个想法是通过将它们一起使用,可以以一种或另一种方式涵盖所有情况。

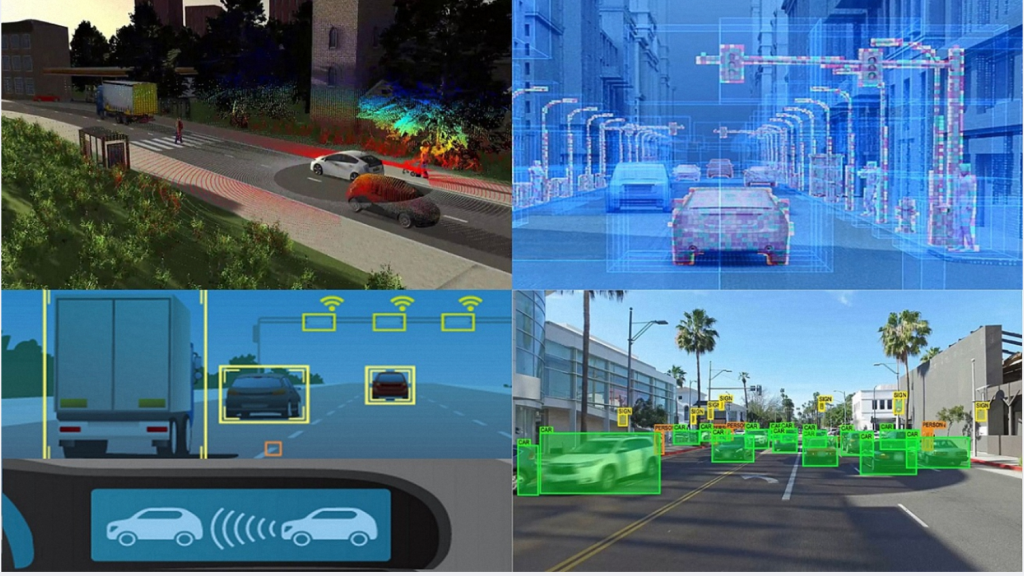

图 1:使用传感器融合的场景理解和导航。资料来源:西门子

原则上,传感器融合可以以几种不同的方式工作。对于一种方法,所有传感器的所有输出始终组合在一起,针对不同情况采用不同的测量方法。另一方面,系统主要依赖于一个传感器,例如相机,除非情况对相机数据的质量产生怀疑——比如低光。其他传感器选项然后作为冗余在需要时介入。

“如果你看看所有这些传感器,是的,它们提供某种重叠或冗余,但它们也提供不同的能力,”卡梅尔说。

也可以融合其他数据,例如 GPS 和地图数据。车辆的位置可以由 GPS 与视野中识别出的地标和车道标记相融合来确定,但可以与地图数据进行交叉检查,以确保计算出的位置有意义。

Rambus 的 Kouthon 说:“这也可以一直延伸到 V2X 连接,这意味着交通灯和铁路道口等基础设施。” “其他汽车也可以与你交流并告诉你,‘小心,你试图超车的卡车前面有另一辆车,你看不到。’”

因此,可以通过多种方式融合数据,融合的质量可以成为一个差异化因素。

是否需要所有传感器?

当然,每个传感器代表一个成本,所以使用更少的成本更低。虽然目前有三个主要的视觉传感器,但对于这三个是否会持续存在意见不一。从三个传感器减少到两个的能力具体取决于传感器融合和人工智能的质量。

英飞凌产品营销总监 Vikram Patel 表示:“当有足够的数据并且人工智能足够智能时,其中一个传感器就会是多余的。” “如果这些汽车原始设备制造商可以只使用雷达和摄像头,我想他们会的。”

当然,激光雷达制造商的看法不同。 “那些人认为我们可以只用激光雷达,也许还有雷达,或者便宜的雷达,然后去掉摄像头,”帕特尔补充道。

最高级别的传感器融合的目标是使用最佳数据做出决策。这对于那些需要做出生死攸关的决策的先进系统至关重要——先进驾驶辅助系统 (ADAS) 或 L4/L5 自动驾驶系统。质量是游戏的最终决定因素。

在局部层面——比如在汽车的一个角落——这可能意味着决定哪些物体在视野中。对于侧向摄像头,这可能意味着识别潜在的行人或标志。在汽车的正面,摄像头可能需要看得更远,并能够计算出恰当的行使速度。

在“全局”层面,这必须满足 ADAS 和自动驾驶的需求。在这里,来自汽车周围的输入相结合,以创建车辆环境的完整图片。 “所有测量、行人、物体检测、对地标的理解、车道标记最终都会导致简单的碰撞时间控制,”卡梅尔说。

三类数据加工

做好这件事需要三种不同的计算,这很容易混淆。首先是视觉数据的简单处理。这是基本的图像处理工作,如颜色转换、去除噪声和归一化数据,所有这些工作都是为了提高下游计算中使用的数据质量。

英飞凌的 Patel 表示:“与我交谈过的每个客户都在谈论将纯原始 ADC 或 FFT 数据转换为更智能或更简洁的数据。 “噪声已经被过滤掉,只有峰值被击中,然后你把它移到你正在使用的任何管道中。”

接下来的两个可能有些交织。 融合(Fusion) 结合了来自不同来源的数据,机器学习 (ML) 可以理解图像。传感器融合不是机器学习,机器学习( ML )也不是传感器融合,严格来说。但是数据可以在呈现给 ML 引擎之前融合,或者 ML 可以用于单个数据流预融合,然后 ML 结果可以融合在一起。

融合架构还必须能够处理在车辆外部生成的数据。西门子 EDA 自动驾驶和 ADAS 高级总监 David Fritz 表示:“智能城市基础设施 [与内部汽车传感器融合] 存在类似问题。 “一方面,它检测物体并对它们进行分类。我如何以一种易于使用的方式将这些信息输入到车辆中?如果他们发送原始数据,他们消耗的 5G 带宽将是惊人的。想想纽约市的 10,000 个十字路口,所有十字路口都同时传输数 TB 的数据。它会淹没系统。那是一个恐怖的情况。”

“假设他们想出了一些压缩的方法来做到这一点,”他继续道。 “然后车辆本身将不得不增加计算能力来解压缩数据。”

让外部源传达车辆可以本地使用的对象元数据将简化数据融合。

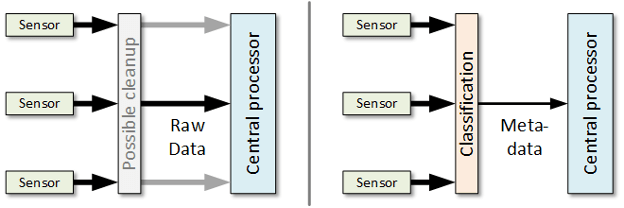

图 2:左侧是传感器数据直接传送到中央处理器的场景,可以是完全原始的,也可以是经过一些小数据清理之后。它可能通过与区域控制器的单一连接或直接连接到中央处理器。在右侧,传感器数据在区域中本地分类,元数据被发送到中央处理器。资料来源:Bryon Moyer/半导体工程

如果这成为处理事情的方式,那么所有这些对象共享都需要一些元数据标准化。弗里茨说:“我们不知道整个行业有任何标准化的行动,尽管这是不可避免的。” “它很可能是由谁先出现并拥有最多市场份额的事实上的标准驱动的。”

然而,这并不是一个需要解决的大问题。他补充说:“实际上,您必须拥有标准化元数据的事物数量是有限的。” “而且每一个的数据量都很小。”

这一切会在哪里发生?

那么考虑到所有这些计算工作,它会在车内的什么地方发生?这是推动车辆架构设计的考虑因素之一。所谓的“区域”架构似乎已成为首选方法,即使并非所有制造商都参与其中。

“下一代架构是区域架构,”Cadence 汽车解决方案总监Robert Schweiger 说,“在汽车的每个角落,都有一个区域控制器,负责管理安装在该物理区域某处的传感器。”

这个想法是由控制器在汽车的有限部分(例如左前部)完成相当多的工作。然后可以将这项工作的结果传送到中央计算机,在那里可以将本地部分组装成全局视图。

“我们看到区域架构的发生仅仅是因为复杂性,”帕特尔说。 “在区域方案中管理和移动数据更容易。”

围绕这个话题的讨论往往集中在原始数据与处理过的数据上,但并不是那么清晰。 “‘原始数据’这个词会导致很多混淆,因为不同的人对原始数据的定义不同,”帕特尔警告说。 “这不仅仅是你今天看到的完全处理过的对象数据。但是你会看到部分处理完成,结果通过以太网管道发送。”

其他人对这种看法也表示同意。 “今天,大多数传感器融合都是面向对象的,而不是原始的,”Tu 指出。 “面向对象的方法需要较少的性能。原始融合将需要更复杂的处理,而且技术是新颖的。”

分区方法通过以模块化和可扩展的方式分配工作来简化系统。例如,低端汽车可能有两个区域,而高端汽车可能有六个或更多区域。将区域控制器作为通用元素,更有可能使控制器容量更高——并且需要控制成本。

“这可能是一个中间立场出现的地方,”Synopsys 的 Swanson 说。 “因此,在区域架构中,您可以进行一定程度的抽象,再将其提供给中央处理单元。”

一些汽车原始设备制造商——尤其是那些从零开始的新制造商——可能会选择一种将所有事情都集中完成的架构。但至少到目前为止,这些 OEM 厂商还没有试图吸引广泛的市场,而是专注于高端市场。

“如果我是特斯拉,我主要生产高端汽车,”帕特尔说。 “我真的不关心低成本汽车的规模化。但是通用汽车和大众汽车——他们会关心的。”

他并不是唯一一个看到这种分裂的人。 “有旧的趋势,传统的原始汽车制造商、宝马、戴姆勒和福特,”Kouthon 说。 “还有一种新趋势——Aptivs、Teslas、Waymos——他们对事物的看法截然不同。”

例如,特斯拉使用极其强大的中央处理单元。 “该芯片接收所有摄像头信号、所有超声波信号和所有雷达信号,并集中处理它们,”Kouthon 说。 “他们的理由是,我们将在中央处理单元和传感器之间的布线级别提供冗余,以减少发生故障的机会。”

这种布线冗余反映了他们在车载数据传输和电子设备供电方面所做的专有工作。通过使用环形架构,无需将网络中的电线加倍即可获得此类冗余。

当然,可靠性对于汽车来说是一个大问题。 “如果你只使用一个中央处理器,你就会不得不在一台计算机上提高可靠性,”斯旺森指出。

也有人认为并非所有决策都需要集中做出。 “可能有很多决定可以在局部做出,”斯旺森说。 “你不需要超级计算机来控制挡风玻璃刮水器的运行频率。”

什么进入区域?

鉴于区域方法,我们现在可以解决将在何处完成什么的问题,尽管供应链中的不同利益可能会有所推动和拉动。

例如,相机制造商可能希望通过自己进行分类然后提供对象元数据来区分。至少,他们可能会在预 ML 和预融合中完成大部分繁重的图像处理。

区域控制器可以执行传感器本身没有执行的任何本地处理。这可能是信号清理,可能是本地机器学习,也可能是本地传感器融合。这一决定的一个重要驱动因素是用于移动数据的带宽。在该区域本地进行的任何处理都会自然地压缩原始数据。该区域可以发送对象元数据,而不是将原始相机数据传送到中央计算机。

区域控制器可以对其视图内的对象进行初始分类。 “区域控制器将是预处理来自这些传感器的数据并将更高级别的对象数据发送到中央计算单元的设备,”Cadence 的 Schweiger 说。 “您可以在区域控制器中进行预融合 [即早期融合],然后在中央计算机中对所有四个区域控制器进行最终融合。预融合还将为您提供减少数据的好处。”

这与决定使用哪些网络来传送所有这些数据密切相关。西门子与 OEM 进行了一些合作不同的设置。

“我们对整辆车做了三个模型,”弗里茨解释说。 “在其中一个模型上,我们将通过汽车以太网将原始传感器数据传送到中央计算机。中央计算机将完成所有传感器融合、物体检测、分类和决策。我们做的第二件事是问,‘如果我们在边缘进行一些传感器计算会怎样?’这将网络带宽减少了大约 40%。”

在这个模型中,西门子从边缘向中央计算机发送了一个 3D 点云。 “第三种选择是在靠近传感器的边缘做所有事情,”弗里茨说。 “然后我们要做的就是传递对象元数据——它的位置、它的分类、它的运动方向等等。我们看到第一种情况需要超过 10 Gbps 才能传输所有原始传感器数据”,这远远超过当前以太网1 Gbps的最大值的。 “只有最后两个被认为是可行的。我们倾向于对象融合,而不是任何类型的 3D 点云。”

这表明可以在该区域实施相当多的工作。但是多少钱?区域控制器的一个重要考虑因素是成本,这可能会限制可以以可接受的价格包含的重型 ML 硬件的数量。这将是划分工作的重要因素。

“从经济的角度来看,你不能将最大的 AI 性能投入到区域控制器中,因为硅面积会太大,”Schweiger 警告说。 “所以这意味着你需要混合。”

也就是说,由于 OEM 试图在区域和中心找到传感器融合和 ML 的最佳组合,因此处理分区的方式可能仍然是专有的。 “他们如何在车辆中分配某些任务可能是 OEM 的秘诀,”施威格指出。

或者简单地说,没有一种尺寸适合所有人。 “这完全取决于制造商及其理念,”Cadence 设计 IP 营销总监 Tom Wong 补充道。 “以及他们在核心中可用的计算资源以及他们愿意消耗的电量。”

一个临时问题?

尽管如此,人们仍然坚信,在没有任何限制的情况下,将所有原始数据带到中央计算机进行计算可以做出最佳决策。通过压缩初始原始数据,所有预处理都牺牲了一些信息以减少带宽。它可能不是最佳的,但现在已经足够了,特别是考虑到车辆暂时会受到带宽限制。

在这种观点中,将区域用于传感器融合和 ML 将是一个过渡性的事情,直到我们能够更有效地将所有数据带到中心。 “目前,这些公司仍在开发非常智能的传感器模块,”Schweiger 说。 “但稍后,这将发生变化,并将转向中央计算单元。”

任何人都在猜测这种情况何时会发生,因为即使我们设计了更快的网络,我们也在添加更多的数据。这表明该区域可以在未来很长一段时间内托管一些这种基本计算。

然而,如果这种转变确实发生了,它并不一定标志着局域架构的结束。许多与传感器融合或 ML 无关的任务仍然可以在本地执行,区域架构提供了一种高效便捷的方法来做到这一点。

“也许有些事情不需要数据融合,”Schweiger 说。 “你只需要预处理一些东西,比如雷达传感器的波束形成。对于这个传感器来说,这是一件单独的事情,它不会推动决策。”

因此,尽管 OEM 采取措施在区域和中心之间提供传感器融合和 ML 计算的最佳组合,但随着时间的推移,它将迁移到中心。例如,这会反对在边缘的相机中执行分类,并且可能会在相机制造商认为他们需要的差异化和原始设备制造商想要做的之间产生争执。

“一旦 OEM 解决了所有这些问题,一切都将更具可扩展性且更易于维护,”Schweiger 指出。 “它可以拥有更简洁的软件架构,因为您不需要刷新 100 个 ECU。”

库顿同意这种看法。 “通过拥有一个网络,您可以将所有内容都带到中央计算机,进行无线更新要容易得多,因为每次您只有几件事情要更新,”他说。

就目前而言,不同的主机厂可能会在不同的地方划分区域和中心之间的界限。灵活性将很重要,无论是在软件中还是在可编程硬件中。 Flex Logix 的 Jaros 说:“关于传感器融合的许多问题,我们都听到了双方的争论。 “我们认为答案是使用 eFPGA 来让系统设计人员拥有一个支持这两种场景的芯片,其中融合是在传感器附近或在中央处理单元中完成的。”

但考虑到车辆的设计方式,这将是一个缓慢的过程。 “你将在 2026 年左右看到这样的解决方案在市场上可用,”弗里茨说。 每个人都需要观察结果如何,并准备在必要时修改他们的策略。